Última atualização: 2026-05-01

O web scraping existe há muito tempo, mas, se antes era uma ferramenta "apenas para programadores", hoje tornou-se acessível a quase toda a gente. As empresas recolhem preços, os profissionais de marketing captam leads, os especialistas em SEO acompanham as SERPs e as startups extraem conjuntos de dados massivos para treinar modelos ou fazer análises de mercado.

Hoje já não é preciso escrever scripts complexos nem manter a sua própria infraestrutura de proxies. As ferramentas modernas de web scraping tratam da maior parte do trabalho rotineiro por si. Vamos ver 8 ferramentas populares de web scraping, mas, antes disso, vamos explicar para que servem e o que deve ter em conta ao escolher uma.

Por que usar web scrapers

Recolher dados manualmente em sites é lento, aborrecido e não escala de forma alguma. Os web scrapers foram concebidos especificamente para automatizar esse processo.

Estas são as razões mais comuns para serem usados:

-

Monitorização de mercado e de preços — acompanhar concorrentes, preços de produtos e disponibilidade em stock.

-

Geração de leads — recolher endereços de email, dados de empresas ou informações de contacto a partir de diretórios públicos.

-

Análise de SEO e SERP — recolher resultados do Google, palavras-chave, snippets e anúncios.

-

Análise de conteúdo e avaliações — recolher reviews, classificações, comentários ou sinais sociais.

-

Dados para analytics ou IA — obter grandes conjuntos de dados para processamento posterior.

Em resumo, o web scraping é necessário para recolher regularmente dados públicos de vários sites.

O que considerar ao escolher um web scraper

Nem todos os scrapers servem para as mesmas tarefas. Cada pessoa tem objetivos diferentes, e cada ferramenta de web scraping tem funcionalidades e limitações próprias. Antes de escolher uma ferramenta, vale a pena pensar em alguns pontos práticos:

-

Facilidade de utilização. Antes de mais, decida que nível de funcionalidade precisa. Se não quer ou não sabe programar, opte por web scrapers no-code ou soluções baseadas no navegador. Para integrações e projetos maiores, os scrapers baseados em API são mais indicados.

-

Volume de scraping. Fazer scraping de 100 páginas uma vez por semana e fazer scraping de 1 milhão de páginas todos os dias são tarefas completamente diferentes. Deve escolher a ferramenta com base na quantidade de dados que pretende extrair, pois nem todas lidam bem com grandes volumes ou mantêm uma boa relação custo-benefício quando se escala.

-

JavaScript e conteúdo dinâmico. Muitos sites modernos dependem muito de JavaScript. Se a ferramenta não conseguir renderizar páginas, rapidamente vai encontrar limitações. Dito isto, todas as ferramentas abaixo lidam bem com renderização de JavaScript.

-

Proteções anti-bot. CAPTCHAs, limites de taxa e bloqueios de IP são a norma. Ferramentas que tratam disso automaticamente poupam-lhe muito tempo. É importante perceber exatamente o que a ferramenta oferece e se consegue resolver os seus desafios específicos.

-

Modelo de preços. Algumas ferramentas cobram por pedido, outras por tempo de execução e outras pelo número de linhas de dados. Não existe um modelo "melhor" universal — tudo depende das suas tarefas. É preciso analisar o modelo de preços de cada ferramenta para ver qual se adequa melhor ao seu caso de uso.

-

Suporte a proxies. Os proxies são essenciais para um scraping estável, especialmente em escala. Na maioria dos casos, as ferramentas modernas já incluem proxies integrados, por isso não precisa de os ligar à parte.

Com isso esclarecido, vamos passar às ferramentas.

1. ScraperAPI

Site oficial: https://scraperapi.com

Teste gratuito: Sim, teste gratuito de 7 dias

Preço: A partir de 49 $ por mês

Descontos: 10% de desconto com faturação anual

O ScraperAPI é uma ferramenta mais indicada para programadores do que para iniciantes. Essencialmente, é uma API simples: você envia um URL, e o ScraperAPI trata de proxies, headers, CAPTCHAs e renderização de JavaScript. Você não vê o que acontece "por baixo do capô" — e esse é precisamente o objetivo. A ferramenta foi feita para quem quer resultados sem gerir infraestrutura.

Principais funcionalidades:

- Rotação automática de proxies

- Contorno de CAPTCHA

- Renderização de JavaScript

- Geo-targeting

Vantagens:

- Muito fácil de integrar em scripts e aplicações

- Não é preciso gerir proxies por conta própria

- Estável para a maioria das tarefas

Desvantagens:

-

Menos flexibilidade para personalização detalhada

2. Apify

Site oficial: https://apify.com

Teste gratuito: Sim, 5 $ em créditos gratuitos

Preço: A partir de 29 $ por mês + utilização pay-as-you-go

Desconto: 10% com faturação anual

O Apify é mais uma plataforma do que apenas um scraper. Pode criar os seus próprios scrapers, executar os que já existem, agendar tarefas, guardar resultados e até vender os seus scrapers num marketplace. Se precisa de flexibilidade e não tem receio de uma curva de aprendizagem, o Apify é uma solução muito poderosa. É frequentemente usado em cenários complexos e tarefas de longa duração.

Principais funcionalidades:

- Milhares de scrapers prontos (Actors)

- Suporte a navegador headless

- API e SDK robustos

- Armazenamento e agendador integrados

Vantagens:

- Máxima flexibilidade

- Adequado tanto para projetos pequenos como muito grandes

- Comunidade ativa e marketplace

Desvantagens:

-

Pode levar bastante tempo a aprender

3. Bright Data

Site oficial: https://brightdata.com

Teste gratuito: Não

Preço: Pay-as-you-go, depende do plano; em média cerca de 1 $ por 1.000 pedidos

Descontos: 25% de desconto para novos utilizadores

O Bright Data é uma solução de nível empresarial. É conhecido sobretudo como fornecedor de proxies, mas as suas ferramentas de web scraping também são muito fortes. O Bright Data é ideal quando soluções mais simples falham, especialmente ao trabalhar com sites fortemente protegidos. Oferece tanto soluções baseadas em API para programadores como web scraping no-code para utilizadores sem perfil técnico.

Principais funcionalidades:

- Enorme pool de proxies

- Web Scraper API e scraper no-code

- Datasets prontos

- Geo-targeting avançado

Vantagens:

- Máxima fiabilidade, sobretudo em escala

- Funciona bem com alvos complexos

- Suporte de nível empresarial

Desvantagens:

-

Preço elevado

4. Octoparse

Site oficial: https://octoparse.com

Teste gratuito: Versão gratuita disponível com limitações

Preço: A partir de 83 $ por mês

Descontos: 16% com faturação anual

O Octoparse é um scraper no-code clássico com interface visual. Está no mercado há muitos anos e é popular entre profissionais de marketing e analistas. As tarefas podem ser executadas localmente ou na cloud, o que é conveniente se não quiser manter o computador ligado o tempo todo.

Principais funcionalidades:

- Construtor visual point-and-click

- Scraping na cloud

- Suporte a paginação, scroll e logins

- Exportação para vários formatos

Vantagens:

- Fácil de usar

- Boa documentação

- Plano gratuito para testes

Desvantagens:

-

Preço elevado

5. ScrapeDO

Site oficial: https://scrape.do

Teste gratuito: Sim, 1.000 créditos disponíveis

Preço: A partir de 29 $ por mês

Descontos: Sem descontos anuais

Esta é uma ferramenta de web scraping baseada em API, fiável e escalável, bem adequada a projetos em que a estabilidade é mais importante do que interfaces visuais.

Principais funcionalidades:

- Alta disponibilidade

- Contorno de CAPTCHA sem complicações

- API simples

Vantagens:

- Funciona bem com recursos protegidos

- Modelo de preços transparente

Desvantagens:

-

Pode parecer complexa para iniciantes

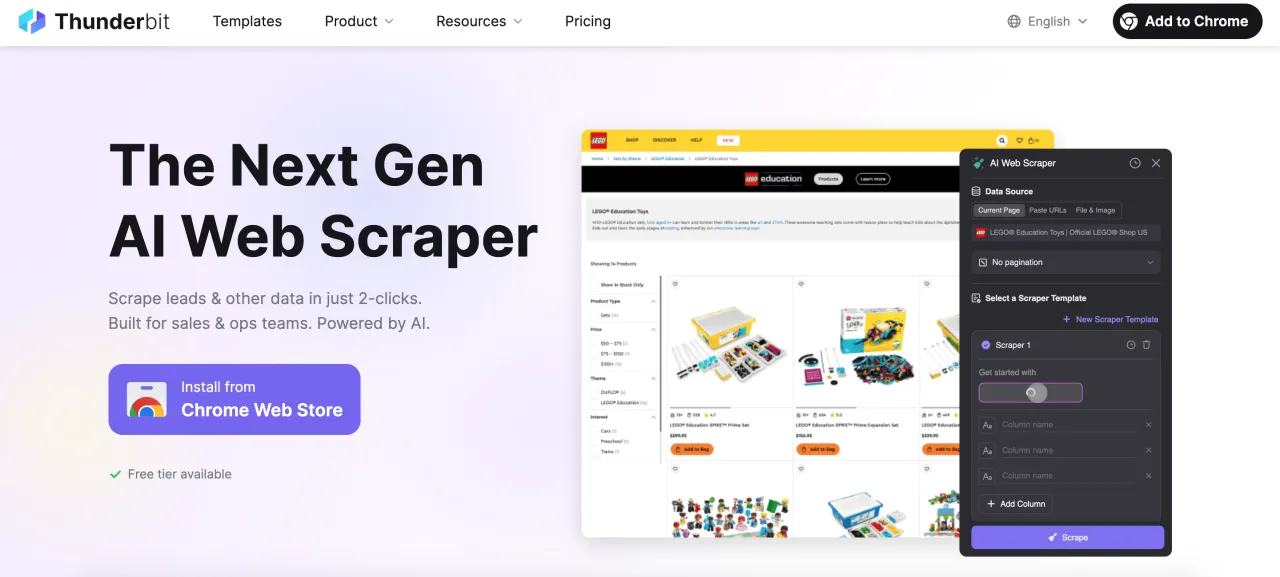

6. Thunderbit

Site oficial: https://thunderbit.com

Teste gratuito: Sim, 6 páginas por mês gratuitamente

Preço: A partir de 15 $ por mês

Descontos: 20% com faturação anual

O Thunderbit é um scraper baseado no navegador, focado em velocidade e simplicidade. Sugestões com IA ajudam a identificar e extrair rapidamente dados comuns como preços ou nomes de produtos. É indicado para tarefas rápidas, equipas comerciais e pesquisa.

Principais funcionalidades:

- Sugestões de campos com IA

- Modelos prontos

- Extensão do browser + execuções na cloud

- Exportação fácil de dados

Vantagens:

- Arranque imediato

- Não requer competências técnicas

- Interface limpa e intuitiva

Desvantagens:

- Plano gratuito muito limitado

- Não é adequada para grandes volumes

7. Axiom

Site oficial: https://axiom.ai

Teste gratuito: Sim (2 horas de runtime do bot)

Preço: A partir de 15 $ por mês

Descontos: Não disponível

O Axiom é direcionado para utilizadores sem conhecimentos técnicos que querem automatizar ações no navegador. Funciona como uma extensão do Chrome e permite criar, de forma visual, fluxos de scraping ou automação. Você literalmente "mostra" à ferramenta o que fazer: clicar aqui, extrair isto, fazer scroll ali, e, depois de configurado, ela repete o processo.

Principais funcionalidades:

- Automação visual no-code

- Funciona diretamente no browser

- Suporte a páginas dinâmicas e logins

- Integrações com Google Sheets e Zapier

Vantagens:

- Muito amigável para iniciantes

- Configuração rápida

- Adequado para tarefas pequenas e médias

Desvantagens:

- Não é adequado para scraping em grande escala

- Na prática, foi concebido para automação mais do que para web scraping puro

8. Browse AI

Site oficial: https://browse.ai

Teste gratuito: 50 créditos por mês, até 2 sites

Preço: A partir de 48 $ por mês

Descontos: 20% com faturação anual

O Browse AI é especialmente bom para monitorizar alterações em sites. Você treina um "robô" uma vez e, depois, ele verifica o site regularmente segundo um agendamento. Isto é conveniente para acompanhar preços, atualizações de conteúdo ou catálogos.

Principais funcionalidades:

- Treino visual do robô

- Monitorização agendada

- Suporte a fluxos de trabalho com várias etapas

Vantagens:

- Excelente para monitorização contínua

- Não é necessário código

Desvantagens:

- Preço elevado

- Não é adequado para grandes volumes

Proxies para web scraping

Por melhor que seja um scraper, os proxies desempenham um papel crucial. Sem eles, será bloqueado muito rapidamente. Para web scraping, a opção mais adequada são proxies residenciais rotativos, pois parecem utilizadores reais e são mais difíceis de detetar. Proxies de datacenter também podem funcionar, são mais baratos e rápidos, mas são bloqueados com mais frequência. Tudo depende do volume de dados, da frequência dos pedidos e dos sites específicos de que pretende fazer scraping. Ainda assim, para web scraping, recomendamos proxies residenciais rotativos, sobretudo ao trabalhar com grandes conjuntos de dados.

Onde obter proxies

É importante perceber que muitas das ferramentas listadas acima já incluem proxies integrados, pelo que não precisa de os comprar separadamente. No entanto, se um scraper não fornecer os seus próprios proxies, terá de os adquirir por conta própria.

Pode escolher um fornecedor de proxies adequado na nossa página: Proxies Residenciais Rotativos

Aqui fica também uma lista dos 5 principais fornecedores de proxies adequados para web scraping:

1. Floppydata

Tipo de Proxy

Proxies móveis, Proxies residenciais, Proxies ISP, Proxies de data center

Pool de IPs

2M+ IP

Data de Estabelecimento

2024

Sede

Emirados Árabes Unidos

Prós e contras

- Interface simples e intuitiva

- Preços baixos para proxies residenciais e móveis

- Os usuários dão feedback positivo

- O tráfego não utilizado é transferido para o mês seguinte

Preço: 1 $/GB com subscrição mensal e 1,5 $/GB em pay-as-you-go.

2. Proxy-Seller

Tipo de Proxy

Proxies móveis, Proxies residenciais, Proxies IPv6 individuais, Proxies ISP, Proxies de data center

Pool de IPs

20M+ IP

Data de Estabelecimento

2014

Sede

Chipre

Prós e contras

- Proxies de alta qualidade

- Preços competitivos

- Ampla seleção de proxies

- Métodos de pagamento convenientes

- Suporte 24/7

Preço: Depende do volume de compra e varia entre 1,45 $ e 3,00 $/GB com subscrição mensal, ou 3,5 $/GB em pay-as-you-go.

3. DataImpulse

Tipo de Proxy

Proxies móveis, Proxies residenciais, Proxies de data center

Pool de IPs

90M+ IP

Data de Estabelecimento

2023

Sede

Estados Unidos

Prós e contras

- Baixo custo de proxy

- Alvo por Estado/Cidade/CEP/ASN

- Pague conforme o uso (o tráfego não expira)

- Sem teste gratuito

Preço: 1 $/GB em pay-as-you-go.

4. Novada

Tipo de Proxy

Proxies móveis, Proxies residenciais, Proxies ISP, Proxies de data center

Pool de IPs

160M+ IP

Data de Estabelecimento

2025

Sede

Alemanha

Prós e contras

- Descontos para pedidos em grande quantidade

- Ampla seleção de proxies

- Suporte 24/7

- Um novo fornecedor de proxies

- Suporte ao cliente deficiente

Preço: Depende do volume de compra e varia entre 2,3 $ e 0,78 $/GB com subscrição mensal.

5. BrightData

Tipo de Proxy

Proxies móveis, Proxies residenciais, Proxies ISP, Proxies de data center

Pool de IPs

150M+ IP

Data de Estabelecimento

2014

Sede

Israel

Prós e contras

- Empresa popular e fiável

- Proxies de alta qualidade, obtidos de forma ética

- Preços flexíveis (incluindo pay-as-you-go)

- Excelente escolha para quem precisa de proxies e ferramentas de web scraping

- Custo acima da média

- O KYC é obrigatório para aceder a todos os websites.

- A interface é complexa e orientada para programadores.

Preço: Depende do volume de compra e varia entre 2,50 $ e 3,50 $/GB com subscrição mensal, ou 4,00 $/GB em pay-as-you-go.

Conclusão

Não existe uma única ferramenta de web scraping que seja a melhor, porque utilizadores diferentes têm necessidades diferentes e as ferramentas são concebidas para resolver tarefas distintas. Como resultado, um web scraper pode ser uma boa escolha para um utilizador, enquanto outra ferramenta pode ser mais adequada para outra pessoa.

Por exemplo, se não é programador e quer extrair dados sem uma configuração complexa, faz sentido considerar ferramentas baseadas no navegador como o Octoparse ou o Thunderbit. Para flexibilidade e escala, Apify ou ScraperAPI são melhores escolhas. E, se estiver a trabalhar com sites fortemente protegidos ou tarefas de nível empresarial, o BrightData continua a ser uma das opções mais fortes. Seja qual for a ferramenta escolhida, teste sempre antes de escalar e mantenha um controlo atento dos custos.