Dernière mise à jour: 2026-05-01

Le web scraping existe depuis longtemps, mais s’il s’agissait autrefois d’un outil "réservé aux développeurs", il est aujourd’hui devenu accessible à presque tout le monde. Les entreprises scrutent les prix, les marketeurs collectent des leads, les spécialistes SEO suivent les SERP, et les startups extraient d’énormes jeux de données pour entraîner des modèles ou analyser un marché.

Aujourd’hui, il n’est plus nécessaire d’écrire des scripts complexes ni d’entretenir sa propre infrastructure de proxy. Les outils modernes de web scraping prennent en charge la plupart des tâches répétitives à votre place. Passons en revue 8 outils de web scraping populaires, mais commençons par expliquer à quoi ils servent et quels points regarder au moment d’en choisir un.

Pourquoi utiliser des web scrapers

Collecter manuellement des données sur des sites web est lent, fastidieux et ne passe pas à l’échelle. Les web scrapers sont conçus précisément pour automatiser ce processus.

Voici les raisons les plus courantes pour lesquelles on les utilise :

-

Surveillance du marché et des prix : suivi des concurrents, des prix des produits et de la disponibilité des stocks.

-

Génération de leads : collecte d’adresses e-mail, de données d’entreprise ou d’informations de contact à partir d’annuaires publics.

-

Analyse SEO et SERP : extraction des résultats Google, des mots-clés, des extraits et des annonces.

-

Analyse de contenu et d’avis : collecte d’avis, de notes, de commentaires ou de signaux sociaux.

-

Données pour l’analytique ou l’IA : obtention de grands volumes de données pour traitement ultérieur.

En bref, le web scraping sert à collecter régulièrement des données publiques à partir de différents sites.

Ce qu’il faut prendre en compte pour choisir un web scraper

Tous les scrapers ne conviennent pas aux mêmes tâches. Les objectifs varient d’une personne à l’autre, et chaque outil de web scraping possède ses propres fonctionnalités et limites. Avant de choisir un outil, il est utile de réfléchir à quelques points pratiques :

-

Facilité d’utilisation. D’abord, déterminez le niveau de fonctionnalités dont vous avez besoin. Si vous ne voulez pas ou ne savez pas coder, privilégiez les web scrapers no-code ou les solutions basées sur le navigateur. Pour les intégrations et les projets plus importants, les scrapers basés sur une API sont généralement plus adaptés.

-

Volume de scraping. Scraper 100 pages une fois par semaine et scraper 1 million de pages chaque jour, ce sont deux réalités totalement différentes. Choisissez un outil en fonction du volume de données que vous comptez extraire, car tous ne gèrent pas bien de grandes quantités ni ne restent rentables à grande échelle.

-

JavaScript et contenu dynamique. Beaucoup de sites modernes s’appuient fortement sur JavaScript. Si un outil ne peut pas rendre les pages, vous atteindrez vite ses limites. Cela dit, tous les outils listés ci-dessous gèrent correctement le rendu JavaScript.

-

Protection anti-bot. CAPTCHAs, limites de débit et bannissements d’IP sont monnaie courante. Les outils qui gèrent cela automatiquement vous font gagner un temps considérable. Il est important de comprendre ce qu’un outil de scraping propose précisément et s’il peut répondre à vos contraintes.

-

Modèle de tarification. Certains outils facturent à la requête, d’autres au temps d’exécution, d’autres encore au nombre de lignes de données. Il n’existe pas de modèle "meilleur" universel : tout dépend de vos besoins. Analysez le modèle de prix de chaque solution pour voir celle qui correspond le mieux à votre cas d’usage.

-

Support des proxys. Les proxys sont essentiels pour un scraping stable, surtout à grande échelle. Dans la plupart des cas, les outils modernes intègrent déjà des proxys, ce qui évite d’avoir à les connecter séparément.

Ceci étant posé, passons aux outils.

1. ScraperAPI

Site officiel : https://scraperapi.com

Essai gratuit : Oui, essai gratuit de 7 jours

Prix : À partir de 49 $ par mois

Réductions : 10 % avec la facturation annuelle

ScraperAPI est un outil plutôt destiné aux développeurs qu’aux débutants. En pratique, c’est une API simple : vous fournissez une URL, et ScraperAPI gère les proxys, les en-têtes, les CAPTCHAs et le rendu JavaScript. Vous ne voyez pas ce qui se passe "sous le capot", et c’est justement l’idée. L’outil s’adresse à ceux qui veulent des résultats sans gérer l’infrastructure.

Fonctionnalités clés :

- Rotation automatique des proxys

- Contournement des CAPTCHAs

- Rendu JavaScript

- Ciblage géographique

Avantages :

- Très simple à intégrer dans des scripts et des applications

- Pas besoin de gérer soi-même les proxys

- Stable pour la plupart des usages

Inconvénients :

-

Moins de flexibilité pour une personnalisation très fine

2. Apify

Site officiel : https://apify.com

Essai gratuit : Oui, 5 $ de crédits offerts

Prix : À partir de 29 $ par mois + usage à la consommation

Réduction : 10 % avec la facturation annuelle

Apify est davantage une plateforme qu’un simple scraper. Vous pouvez créer vos propres scrapers, exécuter des scrapers prêts à l’emploi, planifier des tâches, stocker les résultats, et même vendre vos scrapers sur une marketplace. Si vous avez besoin de flexibilité et que la courbe d’apprentissage ne vous effraie pas, Apify est une solution très puissante. Il est souvent utilisé pour des scénarios complexes et des tâches longues.

Fonctionnalités clés :

- Des milliers de scrapers prêts à l’emploi (Actors)

- Support du navigateur headless

- API et SDK robustes

- Stockage et planificateur intégrés

Avantages :

- Flexibilité maximale

- Adapté aux petits comme aux très grands projets

- Communauté active et marketplace

Inconvénients :

-

Peut demander un temps d’apprentissage conséquent

3. Bright Data

Site officiel : https://brightdata.com

Essai gratuit : Non

Prix : Paiement à l’usage, selon l’offre ; en moyenne environ 1 $ pour 1 000 requêtes

Réductions : 25 % pour les nouveaux utilisateurs

Bright Data est une solution de niveau entreprise. Elle est surtout connue comme fournisseur de proxys, mais ses outils de web scraping sont également très puissants. Bright Data est idéal lorsque des solutions plus simples échouent, notamment face à des sites fortement protégés. Ils proposent à la fois des solutions via API pour les développeurs et du web scraping no-code pour les utilisateurs non techniques.

Fonctionnalités clés :

- Énorme pool de proxys

- Web Scraper API et scraper no-code

- Jeux de données prêts à l’emploi

- Ciblage géographique avancé

Avantages :

- Fiabilité maximale, surtout à grande échelle

- Très efficace sur des cibles complexes

- Support de niveau entreprise

Inconvénients :

-

Prix élevé

4. Octoparse

Site officiel : https://octoparse.com

Essai gratuit : Version gratuite disponible avec des limitations

Prix : À partir de 83 $ par mois

Réductions : 16 % avec la facturation annuelle

Octoparse est un scraper no-code classique avec une interface visuelle. Présent sur le marché depuis de nombreuses années, il est populaire auprès des marketeurs et des analystes. Les tâches peuvent être exécutées en local ou dans le cloud, ce qui est pratique si vous ne voulez pas laisser votre ordinateur allumé en permanence.

Fonctionnalités clés :

- Constructeur visuel par point-and-click

- Scraping dans le cloud

- Prise en charge de la pagination, du défilement et des connexions

- Export vers plusieurs formats

Avantages :

- Simple à utiliser

- Bonne documentation

- Offre gratuite pour tester

Inconvénients :

-

Prix élevé

5. ScrapeDO

Site officiel : https://scrape.do

Essai gratuit : Oui, 1 000 crédits disponibles

Prix : À partir de 29 $ par mois

Réductions : Pas de remise annuelle

C’est un outil de web scraping fiable et scalable basé sur une API, bien adapté aux projets où la stabilité prime sur les interfaces visuelles.

Fonctionnalités clés :

- Haute disponibilité

- Contournement des CAPTCHAs fluide

- API simple

Avantages :

- Fonctionne bien avec des ressources protégées

- Modèle de tarification transparent

Inconvénients :

-

Peut paraître complexe pour les débutants

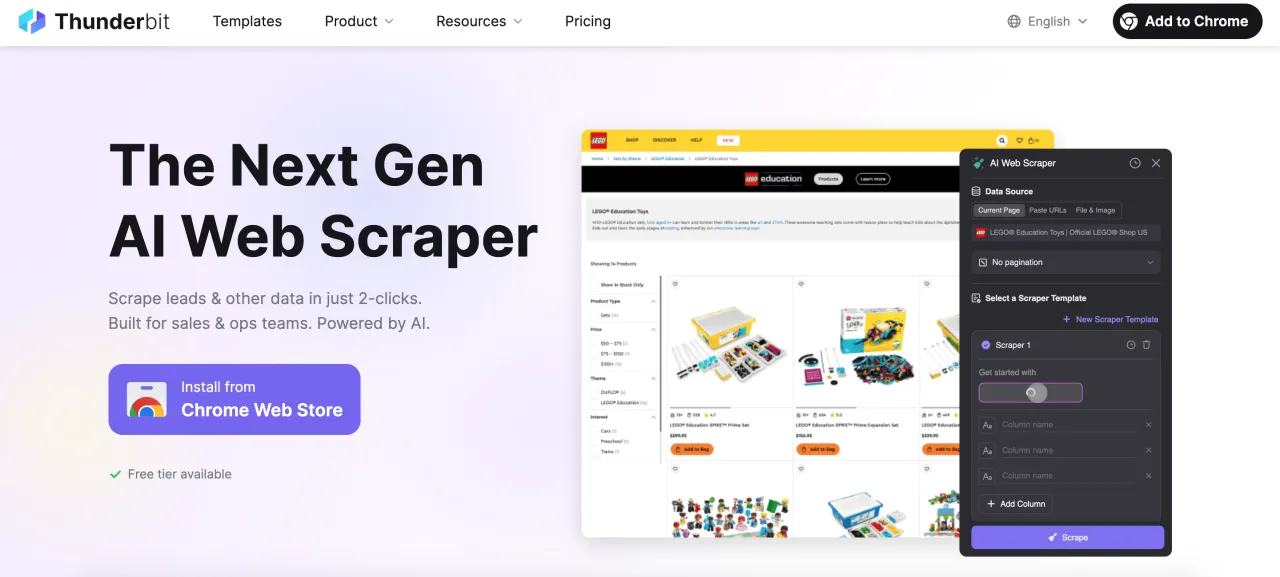

6. Thunderbit

Site officiel : https://thunderbit.com

Essai gratuit : Oui, 6 pages par mois gratuites

Prix : À partir de 15 $ par mois

Réductions : 20 % avec la facturation annuelle

Thunderbit est un scraper basé sur le navigateur, axé sur la rapidité et la simplicité. Des suggestions alimentées par l’IA aident à identifier et extraire rapidement des données courantes comme les prix ou les noms de produits. Il convient bien aux tâches rapides, aux équipes commerciales et à la recherche.

Fonctionnalités clés :

- Suggestions de champs par IA

- Modèles prêts à l’emploi

- Extension de navigateur + exécutions dans le cloud

- Export des données simplifié

Avantages :

- Démarrage immédiat

- Aucune compétence technique requise

- Interface claire et intuitive

Inconvénients :

- Offre gratuite très limitée

- Inadapté aux gros volumes

7. Axiom

Site officiel : https://axiom.ai

Essai gratuit : Oui (2 heures de temps d’exécution du bot)

Prix : À partir de 15 $ par mois

Réductions : Non disponibles

Axiom vise les utilisateurs non techniques qui veulent automatiser des actions dans le navigateur. Il fonctionne sous forme d’extension Chrome et permet de créer visuellement des workflows de scraping ou d’automatisation. Vous "montrez" littéralement à l’outil quoi faire, cliquer ici, extraire ceci, faire défiler là, puis, une fois configuré, il répète le processus.

Fonctionnalités clés :

- Automatisation visuelle no-code

- Fonctionne directement dans le navigateur

- Support des pages dynamiques et des connexions

- Intégrations avec Google Sheets et Zapier

Avantages :

- Très accessible aux débutants

- Mise en place rapide

- Adapté aux tâches petites et moyennes

Inconvénients :

- Inadapté au scraping à grande échelle

- Conçu avant tout pour l’automatisation plutôt que pour le web scraping pur

8. Browse AI

Site officiel : https://browse.ai

Essai gratuit : 50 crédits par mois, jusqu’à 2 sites web

Prix : À partir de 48 $ par mois

Réductions : 20 % avec la facturation annuelle

Browse AI est particulièrement efficace pour surveiller les changements sur les sites. Vous entraînez un "robot" une fois, puis il vérifie régulièrement le site selon un planning. C’est pratique pour suivre des prix, des mises à jour de contenu ou des catalogues.

Fonctionnalités clés :

- Entraînement visuel du robot

- Surveillance planifiée

- Support des workflows en plusieurs étapes

Avantages :

- Excellent pour le monitoring continu

- Aucun code requis

Inconvénients :

- Prix élevé

- Inadapté aux gros volumes

Proxys pour le web scraping

Aussi bon soit-il, un scraper ne suffit pas : les proxys jouent un rôle clé. Sans eux, vous serez bloqué très rapidement. Pour le web scraping, l’option la plus pertinente est celle des proxys résidentiels rotatifs, car ils ressemblent à de vrais utilisateurs et sont plus difficiles à détecter. Les proxys datacenter peuvent aussi convenir : ils sont moins chers et plus rapides, mais se font bloquer plus souvent. Tout dépend du volume de données, de la fréquence des requêtes et des sites que vous comptez scraper. Cela dit, pour le web scraping, nous recommandons des proxys résidentiels rotatifs, surtout lorsque vous travaillez sur de grands ensembles de données.

Où obtenir des proxys

Il est important de comprendre que beaucoup des outils cités plus haut intègrent déjà des proxys, vous n’avez donc pas besoin de les acheter séparément. En revanche, si un scraper ne fournit pas ses propres proxys, il faudra les acheter vous-même.

Vous pouvez choisir un fournisseur de proxy adapté sur notre page : Proxys résidentiels rotatifs

Voici aussi une liste des 5 meilleurs fournisseurs de proxys adaptés au web scraping :

1. Floppydata

Type de proxy

Proxies mobiles, Proxies résidentiels, Proxies ISP, Proxies de centre de données

Pool d'adresses IP

2M+ IP

Date de création

2024

Quartier général

Émirats Arabes Unis

Avantages et inconvénients

- Interface simple et intuitive

- Prix bas pour les proxies résidentiels et mobiles

- Les utilisateurs donnent des avis positifs

- Le trafic non utilisé est reporté au mois suivant

Prix : 1 $/Go avec un abonnement mensuel et 1,5 $/Go en paiement à l’usage.

2. Proxy-Seller

Type de proxy

Proxies mobiles, Proxies résidentiels, Proxies IPv6 individuels, Proxies ISP, Proxies de centre de données

Pool d'adresses IP

20M+ IP

Date de création

2014

Quartier général

Chypre

Avantages et inconvénients

- Proxies de haute qualité

- Prix compétitifs

- Large sélection de proxies

- Méthodes de paiement pratiques

- Assistance 24h/24 et 7j/7

Prix : Dépend du volume d’achat et varie entre 1,45 $ et 3,00 $/Go avec un abonnement mensuel, ou 3,5 $/Go en paiement à l’usage.

3. DataImpulse

Type de proxy

Proxies mobiles, Proxies résidentiels, Proxies de centre de données

Pool d'adresses IP

90M+ IP

Date de création

2023

Quartier général

États-Unis

Avantages et inconvénients

- Faible coût du proxy

- Ciblage par État/Ville/Code postal/ASN

- Paiement à l'utilisation (le trafic n'expire pas)

- Aucun essai gratuit

Prix : 1 $/Go en paiement à l’usage.

4. Novada

Type de proxy

Proxies mobiles, Proxies résidentiels, Proxies ISP, Proxies de centre de données

Pool d'adresses IP

160M+ IP

Date de création

2025

Quartier général

Allemagne

Avantages et inconvénients

- Réductions pour les grosses commandes

- Large choix de proxys

- Assistance 24 h/24 et 7 j/7

- Un nouveau fournisseur de proxys

- Mauvaise assistance client

Prix : Dépend du volume d’achat et varie entre 2,3 $ et 0,78 $/Go avec un abonnement mensuel.

5. BrightData

Type de proxy

Proxies mobiles, Proxies résidentiels, Proxies ISP, Proxies de centre de données

Pool d'adresses IP

150M+ IP

Date de création

2014

Quartier général

Israël

Avantages et inconvénients

- Entreprise populaire et fiable

- Proxies de haute qualité, issus de sources éthiques

- Tarification flexible (y compris le paiement à l’usage)

- Excellent choix pour ceux qui ont besoin de proxies et d’outils de web scraping

- Coût supérieur à la moyenne

- Le KYC est requis pour accéder à tous les sites web.

- L’interface est complexe et orientée vers les développeurs.

Prix : Dépend du volume d’achat et varie entre 2,50 $ et 3,50 $/Go avec un abonnement mensuel, ou 4,00 $/Go en paiement à l’usage.

Conclusion

Il n’existe pas un seul meilleur outil de web scraping, car les besoins diffèrent selon les utilisateurs, et les outils sont conçus pour répondre à des objectifs distincts. Ainsi, un web scraper peut être un excellent choix pour une personne, tandis qu’un autre outil conviendra mieux à quelqu’un d’autre.

Par exemple, si vous n’êtes pas développeur et que vous voulez extraire des données sans configuration complexe, il est logique d’envisager des outils basés sur le navigateur comme Octoparse ou Thunderbit. Pour la flexibilité et le passage à l’échelle, Apify ou ScraperAPI sont de meilleurs choix. Et si vous travaillez avec des sites fortement protégés ou des besoins de niveau entreprise, BrightData reste l’une des options les plus solides. Quel que soit l’outil que vous choisissez, testez toujours avant de passer à l’échelle et surveillez de près les coûts.